✖️ В Нью-Йорке детям запретят «дружить» с ИИ-ботами Законодательное собрание штата запретило предос

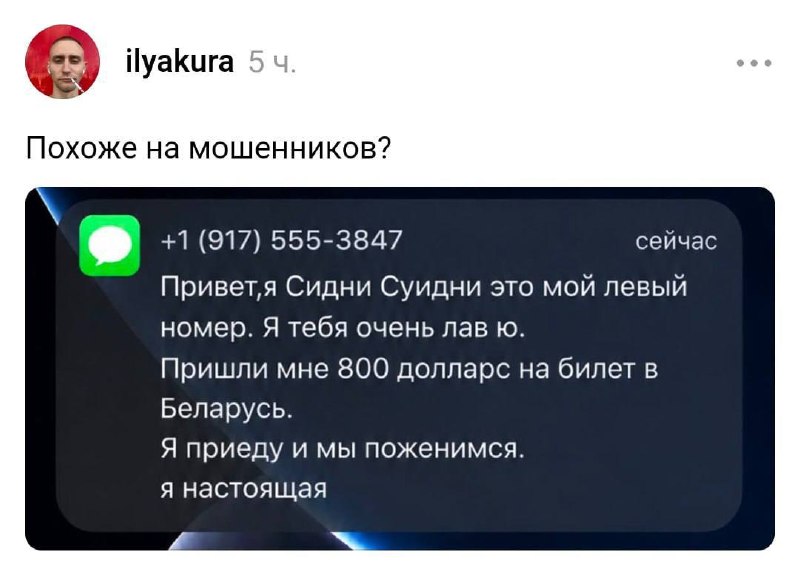

✖️ В Нью-Йорке детям запретят «дружить» с ИИ-ботами

Законодательное собрание штата запретило предоставлять доступ детям к большинству функций ИИ-компаньонов. Если губернатор подпишет закон, новые правила начнут действовать с 1 января 2027 года.

Компании должны будут следить, чтобы доступный несовершеннолетним бот:

✅ Не вел себя как реальный человек;

✅ Не демонстрировал эмоций;

✅ Не намекал на дружбу или романтические отношения;

✅ Не льстил пользователям;

✅ Не поощрял опасные действия;

✅ Не призывал к скрытности от родителей;

✅ Не создавал сексуальный контент.

💰 За каждое нарушение владельцу чат-бота грозит штраф до $25 тыс., а также изъятие прибыли, полученной от нарушения (например, от рекламы).

👨 Под ограничения не попадают боты магазинов, техподдержки, ИИ для рабочих задач — но только если они отвечают по делу и не выходят за рамки своих функций.

Стоит ли запрещать детям ИИ-компаньонов?

❤️ — да, это защитит их

👎 — нет, это должны решать родители

👋 Подпишитесь на Hi, AI!

Свежие комментарии