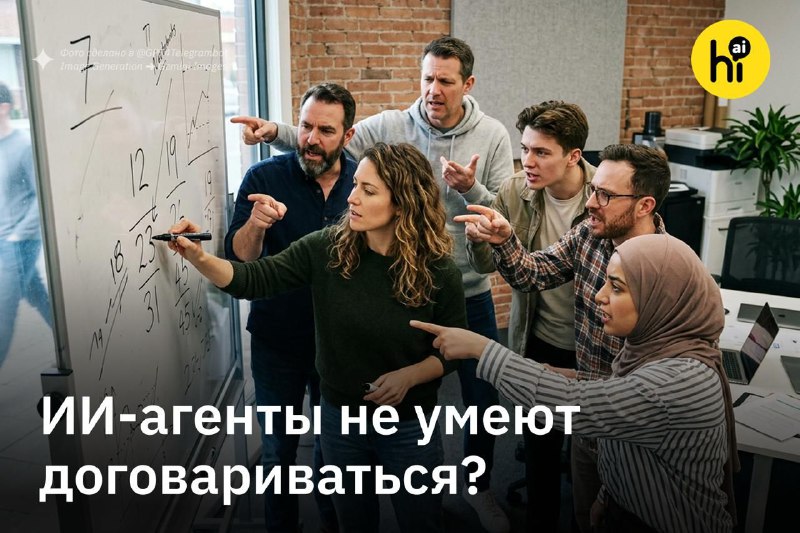

👨💻 ИИ-агенты не могут договориться, даже если им никто не мешает

Исследователи из Швейцарской высшей технической школы Цюриха проверили довольно базовый сценарий: смогут ли ИИ-агенты в общем чате договориться и выбрать одно число от 0 до 50. Для этого они взяли модели Qwen3-8B и Qwen3-14B, запускали группы от 4 до 16 агентов и смотрели не на качество ответа, а на согласие между ними.

Итог оказался неутешительным для адептов идеи автономных роев ИИ: даже в очень простой задаче ИИ-агенты часто не могут нормально договориться между собой. Более сильная модель Qwen3-14B вела себя заметно лучше Qwen3-8B, но и она регулярно застревала, не успевая договориться за отведенные 50 раундов.

🤖 Система «сыпалась» даже без специального саботажа. В стандартном сценарии, где никто специально не мешал ИИ, до согласия дошли только 41,6% запусков, а с ростом числа агентов результат становился хуже.

💻 Когда агентам сообщали, что среди участников может быть саботажник, специально мешающий договориться, их согласованность резко падала из-за «паранойи». А если в систему действительно внедряли хотя бы одного нарушителя, шансов на консенсус почти не оставалось. Авторы подчеркивают: проблема была не в том, что модели выводили неправильное решение, они просто теряли способность договориться.

💡 И это, пожалуй, главное предупреждение для всех, кто мечтает, что группа ИИ-агентов сможет, например, автономно управлять их бизнесом: пока они скорее умеют спорить до бесконечности.

👋 Подпишитесь на Hi, AI!

Комментарии