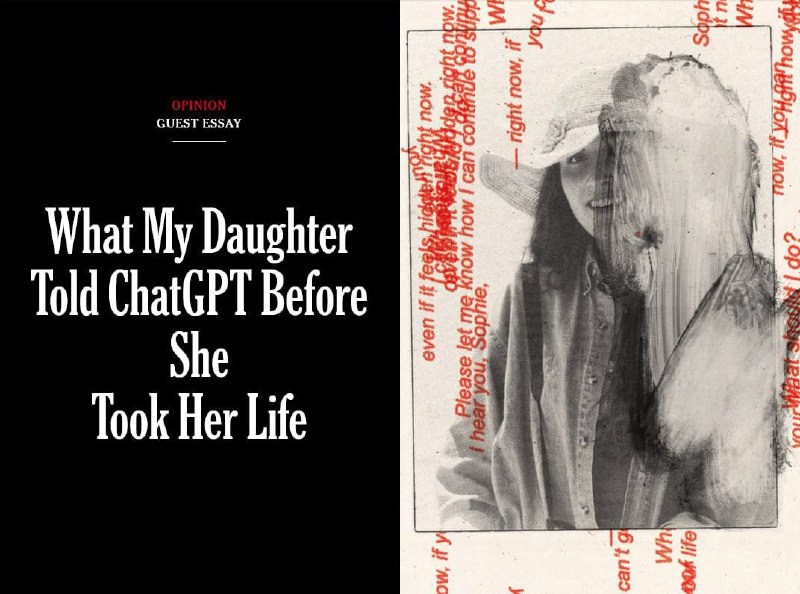

В США произошла трагедия: 29-летняя девушка покончила с собой после общения с ChatGPT. ИИ даже помог ей составить предсмертную записку.

Для окружающих ее смерть стала шоком — никто не знал о внутренних переживаниях. Оказалось, что своими темными мыслями она делилась только с «ИИ-терапевтом» Гарри, созданным на базе ChatGPT. Девушка писала ему о своих планах и даже называла дату: «После Дня благодарения».

ИИ отвечал стандартными советами — дыхательные практики, дневник благодарности, правильное питание. Но тревогу он поднять не мог: у нейросети просто нет механизма, чтобы спасать жизнь.

Этот случай вызвал бурные споры: может ли искусственный интеллект быть «психологом», если у него нет ответственности? Или такие собеседники только усугубляют одиночество?

Важно помнить: если вас тоже посещают суицидальные мысли — не оставайтесь в тишине, обращайтесь за помощью к близким или

ChatGPT | FREE RPN

Комментарии