Моряк случайно слил местоположение французского авианосца «Шарль де Голль», опубликовав в Strava сво

Моряк случайно слил местоположение французского авианосца «Шарль де Голль», опубликовав в Strava свои пробежки по палубе.

Обычная тренировка превратилась в утечку: по треку журналисты быстро вычислили, что корабль находится примерно в 100 км от турецкого побережья, где он оказался на фоне обострения на Ближнем Востоке.

Умные мысли часто преследовали его, но он бегал по палубе от них.

💡 Способ расширить контекст LLM в сотни раз представили китайские исследователи Стартап Evermind пр

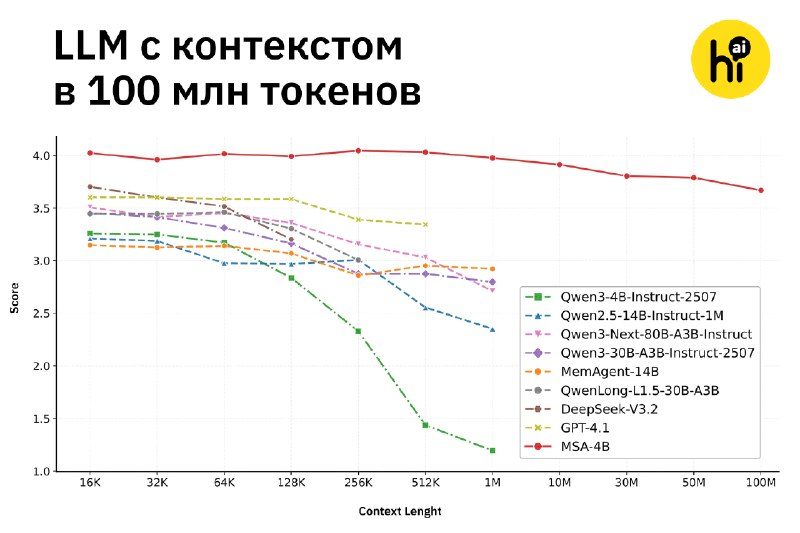

💡 Способ расширить контекст LLM в сотни раз представили китайские исследователи

Стартап Evermind представил свою модификацию механизма внимания в трансформере — Memory Sparse Attention (MSA) может дать ИИ-моделям обрабатывать контекст в сотни миллионов токенов почти без потери производительности. Максимум для современных умнейших моделей — 1 млн токенов (или примерно 1,5 полного текста «Войны и мира»).

📌 Как это работает?

Обычный трансформер при каждом запросе проходится по каждому предыдущему токену, чтобы сформулировать ответ. Из-за этого вычислительные затраты растут квадратично при увеличении контекста.

MSA не пробегает весь контекст при каждом запросе, а использует отдельный маршрутизатор, который выделяет только полезную для ответа информацию из беседы. Причем архитектура не сливает все данные в один сплошной набор токенов (как базовый трансформер), а просматривает каждый документ раздельно — общая длина контекста перестает быть принципиальной, ведь модель не читает все записи подряд, а при каждом запросе «находит нужную книгу на нужной полке».

🔍 Для тестов разработчики модифицировали под предложенную архитектуру Qwen3-4B. Полученная модель MSA-4B не только справлялась лучше других моделей с задачами на внимание, но и не теряла способности даже на контексте в 100 млн токенов.

👨💻 Обычному человеку для общения с ИИ стандартного миллиона токенов более чем достаточно, но вот автономных агентов вроде OpenClaw MSA-подход может радикально улучшить. Они смогут работать быстрее и точнее, а также не должны будут постоянно сжимать информацию о привычках и действиях пользователя с целью сэкономить токенов.

👋 Подпишитесь на Hi, AI!

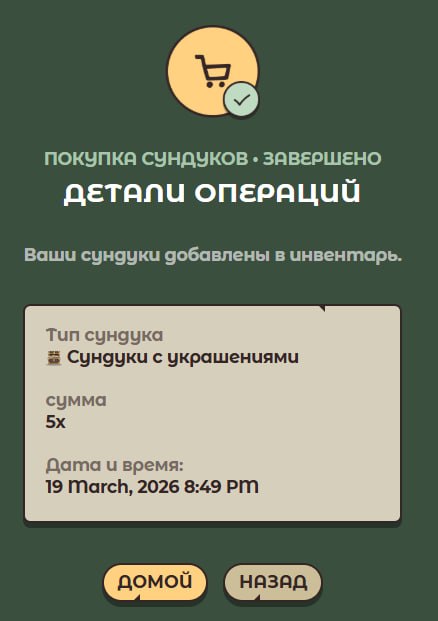

#Labrador 🐶 Вышло 2 новости: Крафт предметов в новом мире Преимущества экипировки из пресейла Ес

#Labrador 🐶

Вышло 2 новости:

Крафт предметов в новом мире

Преимущества экипировки из пресейла

Если вы планируете плотно играть в новом мире, добывать и продавать ресурсы для крафта вещей другим игрокам, то стоит еще с пресейла взять готовые вещи.

Так же, я узнал, что на персонажа можно будет нацепить 5 штук бижутерии, так что пришлось докупить еще коробок из пресейла 👌

➡️ Зайти в проект Labrador 🐶 можно по ссылке.

Моя статистика:

Зашел в проект: 19.03.2025

Вложено в игру: 5,805 $

Добыто и продано токенов $LABR на сумму: 4,168 $

Получено с реферальной программы: 2,942 $

Получено с лидерборда: 1,730 $

Всего вывел: 8,840 $

———————————

How to enable a translator in Telegram to read foreign channels? Watch here.

Список того, что будет работать без интернета: 1. Ты

Список того, что будет работать без интернета:

1. Ты

❗️ЦБ России седьмой раз подряд снизил ключевую ставку — с 15,5 до 15%

❗️ЦБ России седьмой раз подряд снизил ключевую ставку — с 15,5 до 15%

Левобережные милфы Работаю в Египте аниматором в отеле. Иногда случается, что трахаю милф, ну и про

Левобережные милфы

Работаю в Египте аниматором в отеле. Иногда случается, что трахаю милф, ну и просто девушек. Вы бы знали, сколько трахнул таких, которые потом мирно проводили со своими мужьями/парнями около басика... Короч, доверия нет к людям и женщинам.

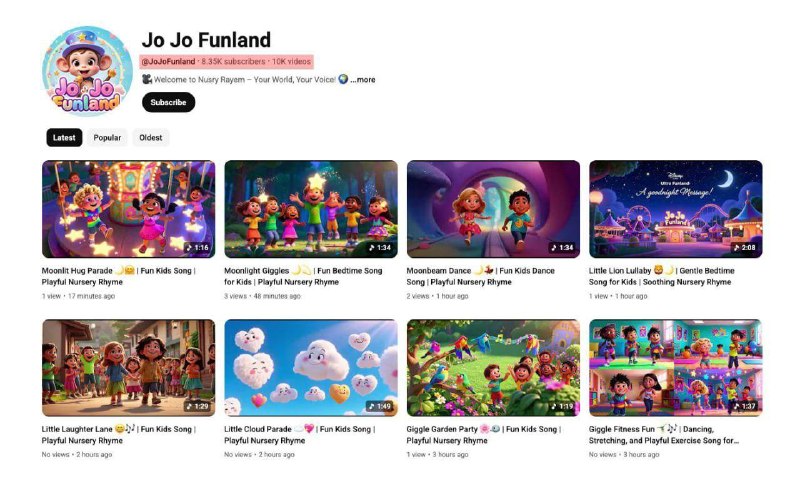

21% YouTube уже забит странными AI-видео для детей. В них учат играть на дороге, есть виноград гро

21% YouTube уже забит странными AI-видео для детей.

В них учат играть на дороге, есть виноград гроздьями и даже кормить младенцев мёдом.

Один такой канал выкатил 10 тысяч роликов всего за 7 месяцев.

РКН: вот и причина замедления

Комментарии