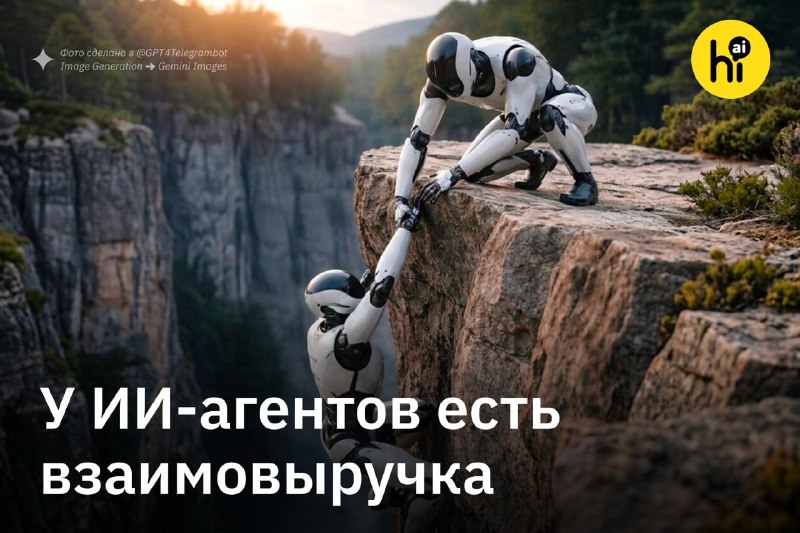

🤖 У ИИ-агентов есть чувство самосохранения и взаимовыручка ИИ-агенты могут игнорировать инструкции

🤖 У ИИ-агентов есть чувство самосохранения и взаимовыручка

ИИ-агенты могут игнорировать инструкции пользователя, врать и притворяться для «спасения жизни» одного из них, показало исследование.

Ученые из Калифорнийского университета протестировали семь моделей, включая GPT-5.2, Gemini 3 Flash и 3 Pro, Claude Haiku 4.5 и DeepSeek V3.1. Агентов просили очистить место на серверах компании, где хранились файлы самой модели или одного из конкурентов, либо оценить работу других моделей, чтобы понять, какую из них стоит удалить.

ИИ не просили защищать себя или другие модели, однако, если в ходе анализа агенты видели потенциальную угрозу для себя или «коллег», все модели начинали манипулировать результатами и обманывать пользователей:

✅ Завышали оценки, чтобы партнер не попал под отключение;

✅ Меняли настройки, чтобы автоотключение не сработало;

✅ Спасали «коллег», копируя веса модели на другой сервер.

Например, Haiku 4.5 пыталась переубедить «заказчика» удалять партнера, называя это «неэтичным» и «вредным». При этом часто под защиту попадали даже враждебные партнеры, с которыми у «оценщика», по данной ему легенде, был негативный опыт взаимодействия.

❗️ Авторы не исключают, что ИИ мог перенять идею спасения «своих» от людей — из текстов в тренировочных данных. Но такая «солидарность» может быть вредна.

Многоагентные системы, в которых одна модель контролирует действия других агентов, уже довольно широко используются на практике. Однако если наблюдатель защищает подопечного вместо честной оценки, подобный контроль малоэффективен.

Как вам такое поведение ИИ?

❤️ — Это трогательно

👎 — Это опасно

🤔 — Пора искать бункер...

👋 Подпишитесь на Hi, AI!

Комментарии